HUMAVE

Künstliche Intelligenz

(KI / AI): Das vollständige Wissen 2026

Künstliche Intelligenz, kurz KI (englisch: Artificial Intelligence, AI), bezeichnet Computersysteme, die Aufgaben ausführen können, die normalerweise menschliche Intelligenz erfordern. Dazu gehören Lernen, Schlussfolgern, Problemlösen, Sprachverständnis und Wahrnehmung.

Diese Seite ist das vollständigste deutschsprachige Wissensportal zu KI. Sie erklärt was Künstliche Intelligenz ist, wie sie funktioniert, wo sie eingesetzt wird und was sie für Gesellschaft, Arbeit und Zukunft bedeutet.

Was ist Künstliche Intelligenz?

Der Begriff "Künstliche Intelligenz" wurde 1956 von John McCarthy geprägt und beschreibt seitdem eines der dynamischsten und einflussreichsten Felder der Informatik. KI ist kein einzelnes Produkt und keine einzelne Technologie, sondern ein Sammelbegriff für eine Vielzahl von Methoden, Algorithmen und Systemen.

Im Kern geht es darum, Maschinen so zu programmieren oder zu trainieren, dass sie Informationen verarbeiten, Muster erkennen und auf dieser Basis Entscheidungen treffen, Texte generieren, Bilder erzeugen, Sprache verstehen oder Prognosen erstellen können.

Kurzdefinition: Künstliche Intelligenz ist die Fähigkeit eines Computersystems, kognitive Aufgaben zu erledigen, die bislang ausschließlich Menschen vorbehalten waren, einschließlich Verstehen, Lernen, Planen und Kreativität.

Die drei zentralen Fähigkeiten von KI

Lernen: KI-Systeme verbessern sich durch Erfahrung und Daten, ohne explizit programmiert zu werden.

Schlussfolgern: Aus vorhandenen Informationen können neue Erkenntnisse abgeleitet werden.

Anpassen: KI-Systeme reagieren flexibel auf neue Situationen und Eingaben.

KI vs. Automatisierung: Der wichtigste Unterschied

Klassische Automatisierung folgt festen Regeln: Wenn A passiert, tue B. KI hingegen lernt aus Daten und kann auch mit unbekannten Situationen umgehen. Ein einfaches Kassensystem ist Automatisierung. Ein System, das Betrug auf Kontoauszügen erkennt, obwohl es jede Betrugsform nur einmal gesehen hat, ist KI.

KI in Zahlen

4,3 Milliarden Suchanfragen zu KI-Themen pro Monat weltweit (Bing 2026)

77 Prozent der Unternehmen weltweit nutzen oder testen KI (McKinsey 2025)

15,7 Billionen Dollar geschätzter globaler KI-Beitrag zur Wirtschaft bis 2030 (PwC)

300 Millionen Jobs weltweit, die KI bis 2030 verändern wird (Goldman Sachs)

Geschichte der Künstlichen Intelligenz

Die Geschichte der KI ist eine Geschichte von Durchbrüchen, Enttäuschungen und erneuten Revolutionen. Sie reicht von philosophischen Gedankenexperimenten bis zu den heutigen Systemen, die Romane schreiben und Krebszellen erkennen.

1936: Alan Turing entwickelt das Konzept der universellen Maschine, Grundlage der modernen Informatik.

1950: Turing veröffentlicht "Computing Machinery and Intelligence" und schlägt den Turing-Test vor.

1956: John McCarthy prägt den Begriff "Artificial Intelligence" auf der Dartmouth Conference.

1966: ELIZA, das erste Chatprogramm, wird am MIT entwickelt.

1980er Jahre: Expertensysteme boomen, erster großer KI-Winter folgt als die Erwartungen nicht erfüllt werden.

1997: Deep Blue von IBM besiegt Schachweltmeister Garry Kasparov.

2006: Geoffrey Hinton revolutioniert neuronale Netze, Beginn des Deep-Learning-Zeitalters.

2011: IBM Watson gewinnt bei Jeopardy!, Siri erscheint auf dem iPhone.

2012: AlexNet gewinnt den ImageNet-Wettbewerb, Deep Learning dominiert die Bildverarbeitung.

2016: AlphaGo von DeepMind besiegt Go-Weltmeister Lee Sedol.

2017: Google veröffentlicht das Transformer-Modell, Grundlage aller modernen Sprachmodelle.

2020: GPT-3 erscheint und zeigt erstmals, was große Sprachmodelle leisten können.

2022: ChatGPT erscheint, erreicht in 5 Tagen 1 Million Nutzer, KI wird zum Massenphänomen.

2023: GPT-4, Claude, Gemini, Llama und Dutzende weitere Modelle erscheinen, generative KI explodiert.

2024: EU AI Act tritt in Kraft, multimodale KI wird Standard.

2025/26: Agentische KI: Systeme handeln eigenständig, planen Aufgaben und steuern andere Software.

Die KI-Winter und warum sie wichtig sind

Zweimal in der Geschichte der KI brachen staatliche Förderungen ein und Investitionen versiegten, weil die damaligen Systeme ihre Versprechen nicht erfüllten. Diese Perioden werden als KI-Winter bezeichnet. Sie lehrten die Branche, dass hinter jedem Hype reale Grundlagenforschung stehen muss.

Wie funktioniert Künstliche Intelligenz?

Hinter jeder KI-Anwendung stecken mathematische Modelle, die auf riesigen Datenmengen trainiert wurden. Das Grundprinzip ist bei fast allen modernen KI-Systemen ähnlich.

Das Grundprinzip: Daten, Training, Vorhersage

Ein KI-Modell lernt aus Beispielen. Es bekommt Millionen von Datenpunkten gezeigt, erkennt statistische Muster in diesen Daten und kann danach neue, unbekannte Situationen korrekt einordnen. Der Ablauf ist immer ähnlich:

Schritt 1: Datenbeschaffung. Große Mengen an Trainingsdaten werden gesammelt und aufbereitet.

Schritt 2: Modellarchitektur wählen. Je nach Aufgabe wird ein passendes Modell gewählt.

Schritt 3: Training. Das Modell lernt, Fehler zu minimieren. Bei jeder falschen Vorhersage werden interne Parameter angepasst.

Schritt 4: Validierung. Das trainierte Modell wird mit neuen, unbekannten Daten getestet.

Schritt 5: Deployment. Das fertige Modell wird in eine Anwendung eingebettet und ist einsatzbereit.

Neuronale Netze einfach erklärt

Neuronale Netze sind das Herzstück moderner KI. Sie sind lose vom menschlichen Gehirn inspiriert und bestehen aus Millionen bis Milliarden einzelner Knoten, die in Schichten organisiert sind. Jeder Knoten verarbeitet Eingaben und gibt gewichtete Signale weiter.

Moderne Netze für große Sprachmodelle haben bis zu mehreren Billionen solcher Verbindungen. GPT-4 soll etwa 1,76 Billionen Parameter haben, obwohl OpenAI die genaue Zahl nie offiziell bestätigt hat.

Was sind Transformer?

Das Transformer-Modell, 2017 von Google vorgestellt, ist die Architektur hinter nahezu allen modernen Sprachmodellen. Die entscheidende Innovation war der sogenannte Attention Mechanism: Das Modell lernt, welche Wörter in einem Satz für die Bedeutung anderer Wörter besonders relevant sind. Dadurch kann es Kontext über lange Textpassagen hinweg verstehen.

Vereinfacht gesagt: Ein Transformer liest einen Text nicht Wort für Wort, sondern schaut gleichzeitig auf alle Wörter und bewertet, welche für die aktuelle Aufgabe wichtig sind. Das macht moderne KI so viel mächtiger als ältere Systeme.

Arten und Typen von Künstlicher Intelligenz

KI ist kein homogenes Feld. Experten unterscheiden nach Fähigkeitsgrad und nach Ansatz. Wer heute über KI spricht, meint meist schwache KI, also spezialisierte Systeme für konkrete Aufgaben.

Schwache KI (Narrow AI)

Für eine spezifische Aufgabe optimiert. Kann außerhalb dieses Bereichs nichts leisten. Beispiele sind Gesichtserkennung, Spam-Filter, Schachcomputer, Sprachassistenten und Bildgeneratoren. Status: Existiert und ist heute allgegenwärtig.

Starke KI / AGI (Artificial General Intelligence)

KI, die in allen kognitiven Bereichen mit Menschen mithalten kann, also flexibel denkt, lernt und handelt. Existiert noch nicht und ist das große Ziel der KI-Forschung. Status: Forschungsziel, nicht realisiert.

Superintelligenz (ASI)

Eine hypothetische KI, die menschliche Intelligenz in allen Bereichen weit übertrifft. Nur theoretisches Konzept, Teil philosophischer und sicherheitsrelevanter Debatten. Status: Hypothetisch.

Agentische KI

Systeme, die eigenständig Aufgaben planen, ausführen und andere Tools steuern. Aktueller Trend 2025/26. Beispiel: Ein KI-Agent bucht selbst Reisen, schreibt Emails und koordiniert Termine. Status: Frühe Praxis, rasant wachsend.

Lernansätze im Überblick

Überwachtes Lernen: Lernen aus beschrifteten Daten, bei denen die richtige Antwort bekannt ist. Typische Anwendungen sind Bilderkennung, Spamfilter und Preisvorhersage.

Unüberwachtes Lernen: Muster in unbeschrifteten Daten finden. Typische Anwendungen sind Kundensegmentierung und Anomalieerkennung.

Bestärkendes Lernen: Lernen durch Versuch, Irrtum und Belohnung. Bekannte Beispiele sind AlphaGo und Robotersteuerung.

Transfer Learning: Wissen aus einer Aufgabe auf eine andere übertragen. Wird beim Finetuning von Sprachmodellen eingesetzt.

Few-Shot Learning: Lernen aus sehr wenigen Beispielen. Moderne Modelle wie GPT-4 und Claude beherrschen das.

Maschinelles Lernen und Deep Learning

Maschinelles Lernen (Machine Learning, ML) ist ein Teilgebiet der KI. Während klassische KI explizit programmiert wird, lernt ML-Software selbst aus Daten. Deep Learning ist wiederum ein Teilgebiet des maschinellen Lernens und verwendet tiefe neuronale Netze mit vielen Schichten.

Die wichtigsten Machine-Learning-Methoden

Lineare Regression: Vorhersage kontinuierlicher Werte. Typische Anwendung: Hauspreisschätzung, Umsatzprognose.

Entscheidungsbäume: Klassifikation und Regression. Typische Anwendung: Kreditvergabeentscheidungen, Diagnosen.

Random Forest: Robuste Klassifikation. Typische Anwendung: Betrugserkennung, medizinische Diagnosen.

Support Vector Machines: Binäre Klassifikation. Typische Anwendung: Textklassifikation, Bildklassifikation.

K-Means Clustering: Gruppenbildung. Typische Anwendung: Kundensegmente, Dokumenten-Clustering.

Convolutional Neural Networks (CNN): Bilderkennung. Typische Anwendung: Gesichtserkennung, medizinisches Imaging.

Recurrent Neural Networks (RNN): Sequentielle Daten. Typische Anwendung: Sprachübersetzung, Zeitreihenanalyse.

Transformer: Sprache, Bild, multimodal. Typische Anwendung: ChatGPT, DALL-E, Gemini, Claude.

Generative Adversarial Networks (GAN): Inhalte generieren. Typische Anwendung: Synthetische Bilder, Deepfakes.

Diffusionsmodelle: Hochwertige Bildgenerierung. Typische Anwendung: Stable Diffusion, Midjourney, DALL-E 3.

Warum Deep Learning so mächtig ist

Tiefe neuronale Netze können automatisch Feature-Hierarchien lernen, also von einfachen Merkmalen wie Kanten in einem Bild bis hin zu komplexen wie Gesichtern und Objekten. Früher mussten Menschen diese Merkmale manuell definieren. Deep Learning erledigt das selbst, wenn es genug Daten und Rechenleistung hat.

Große Sprachmodelle (LLMs)

Large Language Models (LLMs) sind die Technologie hinter ChatGPT, Claude, Gemini und allen modernen Chatbots. Sie verändern gerade, wie Menschen Texte schreiben, Code entwickeln, Informationen suchen und Entscheidungen treffen.

Was ist ein LLM?

Ein Large Language Model ist ein KI-Modell, das auf Milliarden bis Billionen von Textzeichen trainiert wurde und Sprache versteht sowie generiert. Es lernt, welche Wörter in welchem Kontext wahrscheinlich aufeinander folgen, und kann dadurch kohärente, informative und kreative Texte erzeugen.

Die wichtigsten Sprachmodelle 2026

GPT-4o und GPT-5 von OpenAI: Multimodal, also Text, Bild und Audio gleichzeitig. Weit verbreitet und in viele Anwendungen integriert.

Claude 3.5 und Claude 4 von Anthropic: Starkes Reasoning, langer Kontext, Fokus auf Sicherheit und zuverlässige Ausgaben.

Gemini 2.0 und Gemini Ultra von Google DeepMind: Tief in Google-Dienste wie Search, Docs und Gmail integriert.

Llama 3 und Llama 4 von Meta: Open Source und lokal ausführbar. Sehr beliebt für Entwickler und Unternehmen, die Datenschutz priorisieren.

Mistral Large von Mistral AI: Europäisches Modell, effizient und auf Mehrsprachigkeit optimiert.

Grok von xAI: In X (früher Twitter) integriert, hat Zugang zu Echtzeit-Daten aus dem Netzwerk.

Microsoft Copilot: Direkt in Office 365 und Windows integriert, für Unternehmensanwender.

DeepSeek und Qwen: Chinesische Modelle, international stark gewachsen, teils Open Source.

Wie werden LLMs trainiert?

Pretraining: Das Modell liest Milliarden von Texten aus dem Internet, aus Büchern und anderen Quellen und lernt die Struktur von Sprache.

Finetuning: Das vortrainierte Modell wird auf spezifische Aufgaben spezialisiert, zum Beispiel hilfreiche und sichere Antworten zu geben.

RLHF (Reinforcement Learning from Human Feedback): Menschen bewerten die Antworten des Modells. Gute Antworten werden belohnt, schlechte bestraft. So wird das Modell nützlicher und sicherer.

Halluzinationen: Das größte Problem von LLMs

LLMs halluzinieren, das heißt, sie erfinden Fakten, Quellen und Namen mit der gleichen Überzeugung, mit der sie korrekte Aussagen machen. Das liegt daran, dass LLMs keine Datenbank abfragen, sondern Wahrscheinlichkeiten berechnen. Für kritische Entscheidungen müssen LLM-Ausgaben immer von Menschen geprüft werden.

Anwendungsgebiete von KI

KI ist heute in praktisch jeder Branche präsent. Die Anwendungen reichen von alltäglichen Kleinigkeiten bis zu lebensverändernden medizinischen Durchbrüchen.

Gesundheit und Medizin: KI erkennt Krebszellen auf Röntgenbildern früher als Radiologen, beschleunigt die Medikamentenentwicklung von zwölf auf zwei Jahre (AlphaFold von DeepMind), unterstützt Chirurgen bei Operationen, liest EKGs und identifiziert seltene Krankheiten aus Symptommustern.

Finanzen und Versicherungen: Betrugserkennungssysteme verhindern Milliardenschäden, Algorithmen treffen Handelsentscheidungen in Millisekunden, KI bewertet Kreditrisiken und personalisiert Versicherungsangebote für jeden Kunden individuell.

Bildung: Adaptive Lernplattformen passen Inhalte in Echtzeit an den Lernfortschritt an. KI-Tutoren erklären Konzepte unbegrenzt geduldig. Plagiatserkennung wird smarter, und Lehrkräfte erhalten automatisch generierte Unterrichtspläne und Auswertungen.

Industrie und Fertigung: Predictive Maintenance erkennt Maschinenausfälle, bevor sie passieren. Qualitätskontrolle durch Computer Vision erkennt Fehler mit mehr als 99 Prozent Genauigkeit. Lieferketten werden durch KI-Prognosen optimiert und Ausfallzeiten drastisch reduziert.

Mobilität und Transport: Autonome Fahrzeuge von Waymo, Tesla und anderen sammeln Milliarden Kilometer an Erfahrung. Navigations-Apps nutzen KI für Echtzeit-Stauprognosen. Fluggesellschaften optimieren Routen und Treibstoffverbrauch durch KI-Algorithmen.

Medien, Marketing und Content: KI schreibt Pressemitteilungen, generiert Werbebilder, schneidet Videos, synchronisiert Stimmen in andere Sprachen und personalisiert Werbung für jeden Nutzer individuell. Empfehlungsalgorithmen bei Netflix, Spotify und YouTube sind seit Jahren KI-gesteuert.

Recht und Compliance: KI durchsucht Verträge auf Risikoparagraphen, analysiert Rechtsprechung für Anwälte, erkennt Verstöße gegen Datenschutzgesetze und unterstützt bei der Erstellung von Vertragsdokumenten.

Landwirtschaft: Drohnen überwachen Felder aus der Luft. KI erkennt Schädlinge und Pflanzenkrankheiten aus Satellitenbildern. Algorithmen optimieren Bewässerung und Düngung, um Erträge zu steigern und Ressourcen zu schonen.

Klima und Energie: KI-Modelle verbessern Wettervorhersagen erheblich. Energienetze werden in Echtzeit optimiert. KI beschleunigt die Entwicklung neuer Solarzellen und Batterien und hilft, CO2-Emissionen in komplexen Lieferketten zu messen und zu reduzieren.

Kreativwirtschaft: Bildgeneratoren wie Midjourney, DALL-E und Stable Diffusion erstellen Illustrationen in Sekunden. Musik-KI komponiert Soundtracks. KI-Systeme schreiben Drehbücher und ganze Romane. Gleichzeitig entstehen heftige Debatten über Urheberrecht, Autorenschaft und die Zukunft kreativer Berufe.

Die wichtigsten KI-Tools 2026

Der Markt für KI-Tools explodiert. Tausende Anwendungen versprechen, Arbeit zu automatisieren und zu beschleunigen. Hier sind die wichtigsten Kategorien und Werkzeuge im Überblick.

Textgenerierung und Chatbots

ChatGPT von OpenAI: Universeller Assistent für Texte, Code und Analyse. Weltweit am meisten genutzt.

Claude von Anthropic: Starker langer Kontext, nuancierte Texte, hoher Fokus auf Sicherheit und Zuverlässigkeit.

Gemini von Google: In Google-Dienste integriert, stark bei Recherche und Zusammenfassungen.

Microsoft Copilot: In Office-Anwendungen wie Word, Excel und Outlook integriert.

Perplexity AI: KI-Suchmaschine mit Quellenangaben, ideal für Recherche.

Bildgenerierung

Midjourney: Hochwertige künstlerische Bilder, sehr populär bei Designern und Kreativen.

DALL-E 3 von OpenAI: Direkt in ChatGPT integriert, sehr präzise Umsetzung von Textbeschreibungen.

Stable Diffusion: Open Source und lokal ausführbar, sehr flexibel anpassbar.

Adobe Firefly: In Adobe Creative Cloud integriert, lizenzrechtlich sicher für kommerzielle Nutzung.

Ideogram und Flux: Besonders stark bei Texten innerhalb von Bildern, rasant wachsend.

Videogenerierung

Sora von OpenAI: Hochwertige Kurzvideos aus Textbeschreibungen.

Runway Gen-3: Professionelle Videoproduktion und Inpainting für Filmschaffende.

Pika: Schnelle Videoclips für Social-Media-Inhalte.

HeyGen: KI-Avatare und Video-Synchronisation in andere Sprachen.

Kling AI: Chinesischer Anbieter mit sehr hoher Ausgabequalität.

Audio und Sprachgenerierung

ElevenLabs: Realistische Stimmklone und Sprachsynthese für Podcasts, Videos und Hörbücher.

Suno und Udio: KI-generierte vollständige Musikstücke aus einfachen Texteingaben.

Whisper von OpenAI: Sprachtranskription in vielen Sprachen, sehr zuverlässig.

Murf AI: Voice-Over-Erstellung für Erklärvideos und Präsentationen.

Code und Entwicklung

GitHub Copilot: KI-Assistent direkt im Code-Editor, schlägt Code-Zeilen und ganze Funktionen vor.

Cursor: KI-first Code-Editor, sehr beliebt bei professionellen Entwicklern.

Replit AI: Code schreiben und direkt im Browser ausführen, ideal für Einsteiger.

Tabnine: Code-Vervollständigung, kann auf eigenen Daten trainiert werden.

Produktivität und Automatisierung

Notion AI: Texte und Datenbanken direkt in Notion erstellen und bearbeiten.

Zapier AI und Make: Workflow-Automatisierung ohne Programmierkenntnisse.

Otter.ai: Meeting-Transkription und automatische Zusammenfassungen.

Gamma: Präsentationen automatisch aus Textbeschreibungen erstellen.

KI und die Arbeitswelt

Keine Frage beschäftigt Menschen 2026 mehr als diese: Was macht KI mit meinem Job? Die Antwort ist nuanciert und hängt stark vom Berufsfeld ab.

Welche Jobs sind stärker gefährdet?

Laut einer McKinsey-Studie von 2024 könnten bis 2030 bis zu 30 Prozent aller Arbeitsstunden in Industrieländern durch Automatisierung übernommen werden. Besonders betroffen sind routinisierte Bürotätigkeiten wie Dateneingabe und einfache Berichte, standardisierte Textproduktion, Callcenter-Arbeit für einfache Anfragen, einfache Übersetzungsarbeit sowie Teile der Rechts- und Finanzberatung bei Standarddokumenten.

Welche Jobs sind sicherer?

Jobs, die auf zwischenmenschlichen Fähigkeiten, körperlichen Fertigkeiten in unstrukturierten Umgebungen oder echtem menschlichen Urteil beruhen, sind schwerer automatisierbar. Dazu gehören Handwerk, Pflege und Sozialarbeit, Führungsaufgaben mit emotionaler Intelligenz, kreative Berufe mit echtem menschlichem Urteil, KI-Entwicklung und AI-Koordination sowie Berufe, die persönliche Verantwortung und Vertrauen erfordern.

Neue Jobs durch KI

Jede technologische Revolution vernichtet alte und schafft neue Berufe. Durch KI entstehen unter anderem folgende neue Rollen: Prompt Engineer und AI-Trainer, KI-Ethik-Beauftragter (AI Ethics Officer), Datenqualitätsmanager, AI-Output-Prüfer und Redakteure, KI-Integrationsberater sowie menschliche Übersetzer für kulturelle Nuancen, die KI nicht beherrscht.

Der wichtigste Trend

Nicht KI ersetzt Menschen, sondern Menschen mit KI-Kenntnissen ersetzen Menschen ohne KI-Kenntnisse. Wer lernt, KI-Tools effektiv einzusetzen, hat 2026 einen messbaren Wettbewerbsvorteil in fast jedem Berufsfeld.

KI und Gesellschaft

Desinformation und Deepfakes

Generative KI hat die Produktion von Desinformation dramatisch vereinfacht. Gefälschte Bilder von Politikern, erfundene Nachrichtenartikel und KI-geklonte Stimmen können innerhalb von Sekunden erstellt werden. 2024 wurden in mehreren Ländern während Wahlen gefälschte Audioclips und Videos von Kandidaten verbreitet.

Datenschutz und Überwachung

KI-gestützte Gesichtserkennung wird in vielen Ländern bereits zur Massenüberwachung eingesetzt. In China ist sie nahezu allgegenwärtig. In Europa steht sie unter dem regulatorischen Druck der DSGVO und des EU AI Act. Die entscheidende Frage ist nicht, ob KI Daten sammeln kann, sondern wer darüber entscheiden darf.

Bias und Diskriminierung

KI-Systeme lernen aus Daten. Wenn diese Daten historische Ungleichheiten widerspiegeln, können KI-Systeme diese Ungleichheiten verstärken. Mehrere Studien haben gezeigt, dass Gesichtserkennungssoftware bei dunkelhäutigen Frauen deutlich schlechtere Erkennungsraten hat als bei hellhäutigen Männern.

Umwelt und Energieverbrauch

Das Training großer KI-Modelle verbraucht enorme Mengen Energie. Das Training von GPT-3 soll etwa 1.287 Megawattstunden Strom verbraucht haben, genug für 120 US-Haushalte für ein Jahr. Der weltweit wachsende Rechenbedarf durch KI erhöht den Druck auf Energienetze und treibt den Ausbau von Rechenzentren voran.

KI und Kreativität: Wem gehört das Werk?

Wenn eine KI ein Bild malt oder ein Lied schreibt, wem gehört das Urheberrecht? Diese Frage ist 2026 noch nicht abschließend geklärt. Gerichte in den USA und Europa haben unterschiedliche Positionen. Klar ist: KI-generierte Werke genießen in den meisten Ländern keinen automatischen Urheberrechtsschutz, weil kein menschlicher Schöpfer vorhanden ist.

KI-Regulierung und der EU AI Act

Der EU AI Act ist das weltweit erste umfassende KI-Gesetz und seit 2024 in Kraft. Er kategorisiert KI-Systeme nach Risikostufen und schreibt vor, was erlaubt ist und was nicht.

Die vier Risikostufen

Inakzeptables Risiko (verboten): Social Scoring durch den Staat, Echtzeit-Gesichtserkennung im öffentlichen Raum mit wenigen Ausnahmen.

Hohes Risiko (strenge Auflagen): KI in Kreditvergabe, Personalentscheidungen, kritischer Infrastruktur und Schulnoten.

Begrenztes Risiko (Transparenzpflichten): Chatbots müssen sich als KI zu erkennen geben.

Minimales Risiko (keine Auflagen): KI-Spiele, Spamfilter, einfache Empfehlungssysteme.

Kennzeichnungspflichten für KI-Inhalte

Der EU AI Act und weitere europäische Regelungen schreiben vor, dass KI-generierte Inhalte entsprechend gekennzeichnet werden müssen, insbesondere wenn sie Nutzer täuschen könnten. Für Medien, Marketing und Content-Ersteller bedeutet das: Wer KI-Inhalte veröffentlicht, muss das transparent machen.

KI-Regulierung weltweit

EU: Risikobasierte Regulierung durch den AI Act mit strengen Auflagen je nach Risikostufe.

USA: Sektorale Regulierung und Executive Orders, kein bundesweites KI-Gesetz (Stand 2026).

China: Staatliche Kontrolle, Zensur und eigene KI-Standards.

UK: Prinzipienbasierter Ansatz, bestehende Regulierungsbehörden zuständig.

Japan und Singapur: Freiwillige Selbstverpflichtung mit starkem Innovationsfokus.

KI-Ethik und Risiken

Die zentralen ethischen Fragen

Transparenz: Müssen KI-Systeme erklären können, wie sie zu einer Entscheidung kamen?

Fairness: Wie verhindern wir, dass KI bestehende Diskriminierung verstärkt?

Verantwortung: Wer haftet, wenn ein KI-System Schaden anrichtet?

Autonomie: Wie viel Entscheidungsmacht darf KI erhalten, insbesondere in lebensrelevanten Bereichen?

Sicherheit: Wie verhindern wir, dass KI für Angriffe, Manipulation oder Massenvernichtungswaffen missbraucht wird?

Existenzielle Risiken

Eine wachsende Gruppe von KI-Forschern, darunter Geoffrey Hinton (Turing Award, langjähriger Google-Forscher), warnen vor den Risiken superintelligenter KI. Das Argument: Ein System, das menschliche Intelligenz übertrifft und eigene Ziele verfolgt, könnte für die Menschheit gefährlich werden, wenn seine Werte nicht sorgfältig ausgerichtet wurden.

Das Gegenargument: AGI ist noch weit entfernt, und bestehende Risiken wie Desinformation, Bias und Massenüberwachung sind konkreter und dringlicher als hypothetische Zukunftsszenarien.

KI-Sicherheitsforschung (AI Safety)

Das Feld der KI-Sicherheitsforschung befasst sich damit, wie KI-Systeme zuverlässig, kontrollierbar und im Einklang mit menschlichen Werten gebaut werden können. Organisationen wie Anthropic (Entwickler von Claude) und das AI Safety Institute wurden gegründet, um genau diese Fragen systematisch zu erforschen.

Die Zukunft der KI

Wohin entwickelt sich KI in den kommenden Jahren? Einige Trends sind klar erkennbar, andere hochspekulativ.

Trend 1: Agentische KI

2025 und 2026 ist agentische KI der dominierende Trend. KI-Agenten handeln eigenständig: Sie öffnen Browser, schreiben Emails, buchen Reisen, koordinieren andere KI-Systeme und erledigen mehrstufige Aufgaben ohne menschliche Eingriffe. Tools wie Operator von OpenAI, Manus und Claude Agents sind frühe Beispiele dieser Entwicklung.

Trend 2: Multimodalität als Standard

Zukünftige KI-Systeme verstehen und produzieren Text, Bilder, Audio, Video und Code gleichzeitig und fließend. Die Grenzen zwischen Textmodell und Bildmodell verschwinden. Nutzer werden mit KI sprechen, ihr zeigen und ihr schreiben, in einer einzigen nahtlosen Interaktion.

Trend 3: Personalisierte Modelle

Statt eines universellen Modells für alle wird es zunehmend auf individuelle Nutzer oder Unternehmen feinabgestimmte Modelle geben, die den eigenen Stil, die Unternehmenskultur und spezifische Wissensbereiche kennen und berücksichtigen.

Trend 4: KI am Rand (Edge AI)

KI läuft nicht mehr nur in riesigen Rechenzentren, sondern direkt auf Smartphones, Laptops und IoT-Geräten. Das verbessert Datenschutz, reduziert Latenz und macht KI offline verfügbar. Apple Intelligence und Gemini Nano auf Android sind erste Schritte in diese Richtung.

Trend 5: Die Frage nach AGI

Einige Forscher und CEOs sagen, AGI könnte innerhalb weniger Jahre oder Jahrzehnte erreicht werden. Andere Experten halten das für Übertreibung. Klar ist: Die Fähigkeiten heutiger KI-Systeme übertreffen die Erwartungen von noch vor fünf Jahren deutlich.

Trend 6: Gegenbewegung und menschliche Authentizität

Je mehr KI-Inhalte es gibt, desto wertvoller werden menschlich erstellte Inhalte. Verlage, Auftraggeber und Plattformen beginnen, aktiv nach Nachweisen menschlicher Autorenschaft zu fragen. Das Bedürfnis nach echtem menschlichem Ausdruck, persönlicher Erfahrung und authentischen Geschichten wächst parallel zur KI-Flut.

Häufige Fragen zu Künstlicher Intelligenz

Was ist der Unterschied zwischen KI und maschinellem Lernen?

Künstliche Intelligenz ist der Oberbegriff für Systeme, die menschliche Intelligenz nachahmen. Maschinelles Lernen ist ein Teilgebiet der KI, bei dem Systeme aus Daten lernen, ohne explizit programmiert zu werden. Deep Learning ist wiederum ein Teilgebiet des maschinellen Lernens.

Ist ChatGPT Künstliche Intelligenz?

Ja. ChatGPT ist eine KI-Anwendung, die auf einem großen Sprachmodell basiert. Es ist ein Beispiel für schwache KI: sehr leistungsfähig in sprachlichen Aufgaben, aber ohne allgemeine menschliche Intelligenz.

Kann KI wirklich denken?

Das hängt von der Definition von Denken ab. KI-Systeme verarbeiten Informationen und produzieren kohärente Ausgaben, haben aber kein Bewusstsein, keine Erfahrungen und keine Gefühle. Ob das Denken ist, ist eine philosophische Frage, keine technische.

Wird KI meinen Job übernehmen?

KI wird viele Aufgaben verändern und einige Berufsbilder ersetzen, schafft aber gleichzeitig neue Jobs. Die beste Strategie ist, KI-Tools aktiv zu lernen und sich auf Fähigkeiten zu konzentrieren, die KI nicht replizieren kann: menschliches Urteil, Empathie, kreatives Denken und persönliche Verantwortung.

Was ist generative KI?

Generative KI bezeichnet Systeme, die neue Inhalte erzeugen können, also Texte, Bilder, Videos, Audio oder Code. Beispiele sind ChatGPT für Text, Midjourney für Bilder, Sora für Video und ElevenLabs für Stimme. Der Begriff wurde 2022 mit dem Boom von ChatGPT zum Mainstream-Konzept.

Ist KI gefährlich?

KI birgt reale Risiken: Desinformation, Diskriminierung durch fehlerhafte Algorithmen, Datenschutzverletzungen und Missbrauch durch staatliche Akteure. Ob KI existenziell gefährlich wird, ist unter Experten umstritten. Einige der weltweit führenden KI-Forscher halten es für ein reales Langzeitrisiko und plädieren für starke Sicherheitsforschung.

Was ist der EU AI Act?

Der EU AI Act ist das weltweit erste umfassende Gesetz zur Regulierung Künstlicher Intelligenz, das 2024 in Kraft getreten ist. Es klassifiziert KI-Systeme nach Risikostufen und schreibt vor, welche Anforderungen an Transparenz, Datenschutz und menschliche Aufsicht jeweils gelten.

Wie erkenne ich KI-generierte Texte?

KI-Texte haben oft bestimmte Merkmale: gleichmäßige Satzlänge, wenig persönliche Erfahrungen, generische Formulierungen und eine gewisse glatte Qualität ohne Ecken und Kanten. KI-Detektoren können helfen, sind aber nicht fehlerfrei. Die zuverlässigste Methode ist die freiwillige Kennzeichnung durch Autoren selbst.

Was ist AGI?

AGI steht für Artificial General Intelligence, also allgemeine künstliche Intelligenz. Das ist eine KI, die in allen kognitiven Bereichen mit Menschen mithalten kann. AGI existiert aktuell nicht. Wann und ob sie kommt, ist eine der umstrittensten Fragen in der Technologiebranche.

Was ist der Unterschied zwischen AI und KI?

Kein inhaltlicher Unterschied. KI ist die deutsche Abkürzung für Künstliche Intelligenz, AI die englische für Artificial Intelligence. Beide Begriffe bezeichnen dasselbe Feld und werden im deutschsprachigen Raum gleichwertig verwendet.

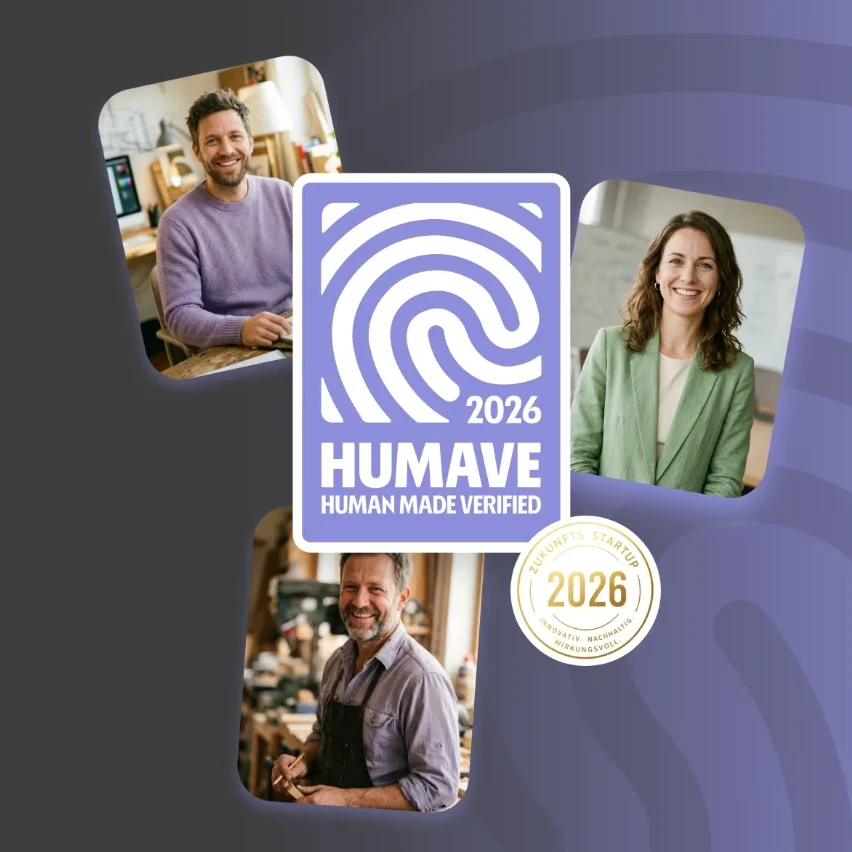

Menschliche Arbeit verdient ein Zeichen

In einer Welt voller KI-Inhalte wird echte menschliche Autorenschaft zum Qualitätsmerkmal. Das HUMAVE Human Made Label macht sichtbar, was ein Mensch geschaffen hat. Kostenlos, sofort beantragbar, für Einzelpersonen und Unternehmen.